IA do Google ERRA e “transforma” Mike Patton em criminoso sexual

DEIXANDO CLARO DESDE O INÍCIO DESSE TEXTO QUE NÃO HÁ NENHUMA ACUSAÇÃO, SUSPEITA OU INDICATÓRIO DE QUE MIKE PATTON ESTEJA ENVOLVIDO COM CRIMES DE CONDUTA SEXUAL.

A confiabilidade da inteligência artificial generativa voltou a ser colocada em xeque após um erro sério envolvendo o nome de Mike Patton, vocalista do Faith No More, Mr. Bungle, Fantômas e outros projetos de grande relevância dentro do rock.

Um usuário do subreddit dedicado ao Faith No More publicou uma captura de tela de um resumo de busca gerado por IA do Google que confundia o músico com um homem do mesmo nome que está envolvido em um crime sexual nos Estados Unidos. Segundo o texto exibido pela ferramenta, Mike Patton teria sido “envolvido em acusações criminais em 2000”, culminando em uma confissão de culpa e liberdade condicional.

O problema se agravava quando, logo na sequência, o mesmo resumo misturava essa informação com conflitos internos da banda, citando demissões no Faith No More, antes de afirmar que “esses casos são distintos de alegações de má conduta sexual” — criando uma ASSOCIAÇÃO e ENGANOSA entre fatos completamente desconectados.

IA confundiu músico com criminoso homônimo

Não há qualquer registro ou acusação de que Mike Patton, o músico, tenha se envolvido em crimes dessa natureza. A confusão ocorreu porque a IA teria extraído informações de documentos judiciais relacionados a outro indivíduo chamado Mike Patton, sem qualquer ligação com o artista.

O caso evidencia uma das maiores fragilidades da IA generativa: a capacidade de combinar informações de múltiplas fontes sem verificação humana, tratando dados não relacionados como se fossem parte de um mesmo contexto.

Como apontado na publicação original do Reddit, a ferramenta “simplesmente errou completamente em algo básico”, ao não diferenciar duas pessoas com o mesmo nome — erro que, neste caso, poderia ter consequências extremamente sérias para a reputação de um artista público.

Google corrige resultado após repercussão

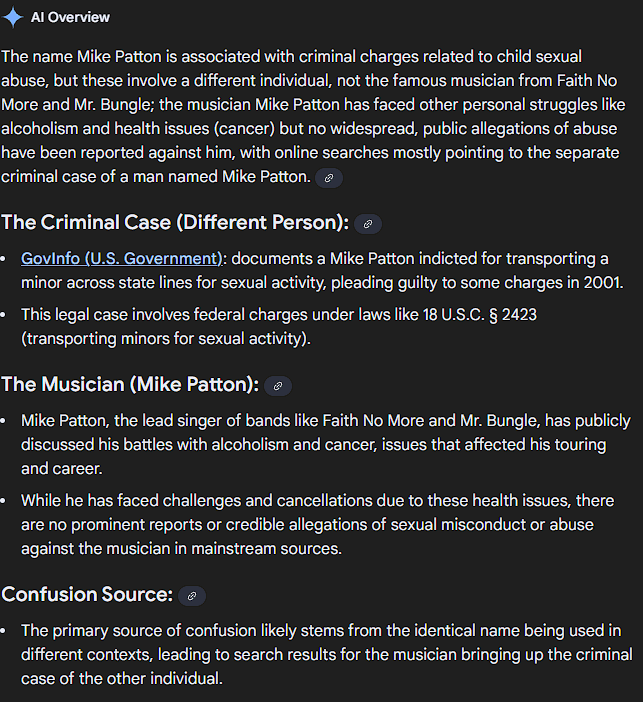

Após a repercussão do caso, o Google aparentemente corrigiu o problema. Uma nova busca por termos semelhantes agora indica que, embora exista uma acusação criminal associada a um nome igual, o músico Mike Patton não é alvo de alegações públicas ou generalizadas de abuso.

A própria IA passou a reconhecer a origem do erro, afirmando que a confusão “provavelmente decorre do uso do mesmo nome em contextos diferentes, levando os resultados da busca pelo músico a exibirem o processo criminal de outra pessoa”.

Debate sobre os riscos da inteligência artificial

O episódio reacendeu discussões sobre os limites da inteligência artificial, especialmente quando aplicada a mecanismos de busca amplamente utilizados. Sem supervisão humana adequada, erros desse tipo podem gerar desinformação, danos à imagem pública e até riscos legais.

Casos como esse reforçam a necessidade de cautela no uso de ferramentas de IA, sobretudo quando envolvem nomes reais, acusações criminais e figuras públicas. Embora a tecnologia avance rapidamente, episódios assim mostram que ela ainda está longe de ser infalível — e que seus erros podem ter impactos reais e profundos.

Abaixo, segue o print do erro cometido pela IA do Google